Attualità

Democrazie armate di algoritmi

Il rifiuto della società di IA Anthropic alle richieste del Pentagono sull’uso militare degli algoritmi apre una questione più vasta: nelle democrazie avanzate, la difesa nazionale dipende sempre più da infrastrutture algoritmiche sviluppate da attori privati. La sovranità non scompare, ma si ibrida. E la decisione sulla forza rischia di diventare opaca, sottratta alla coscienza umana e al controllo democratico

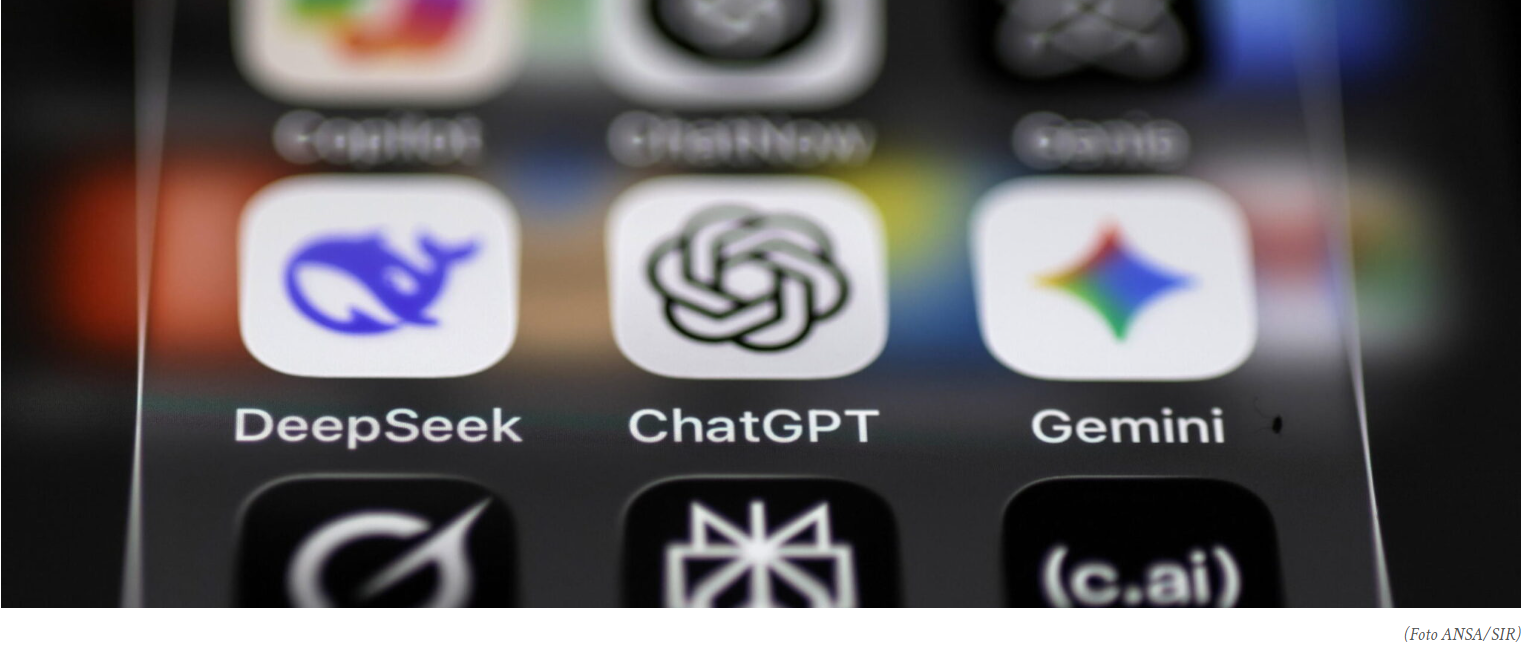

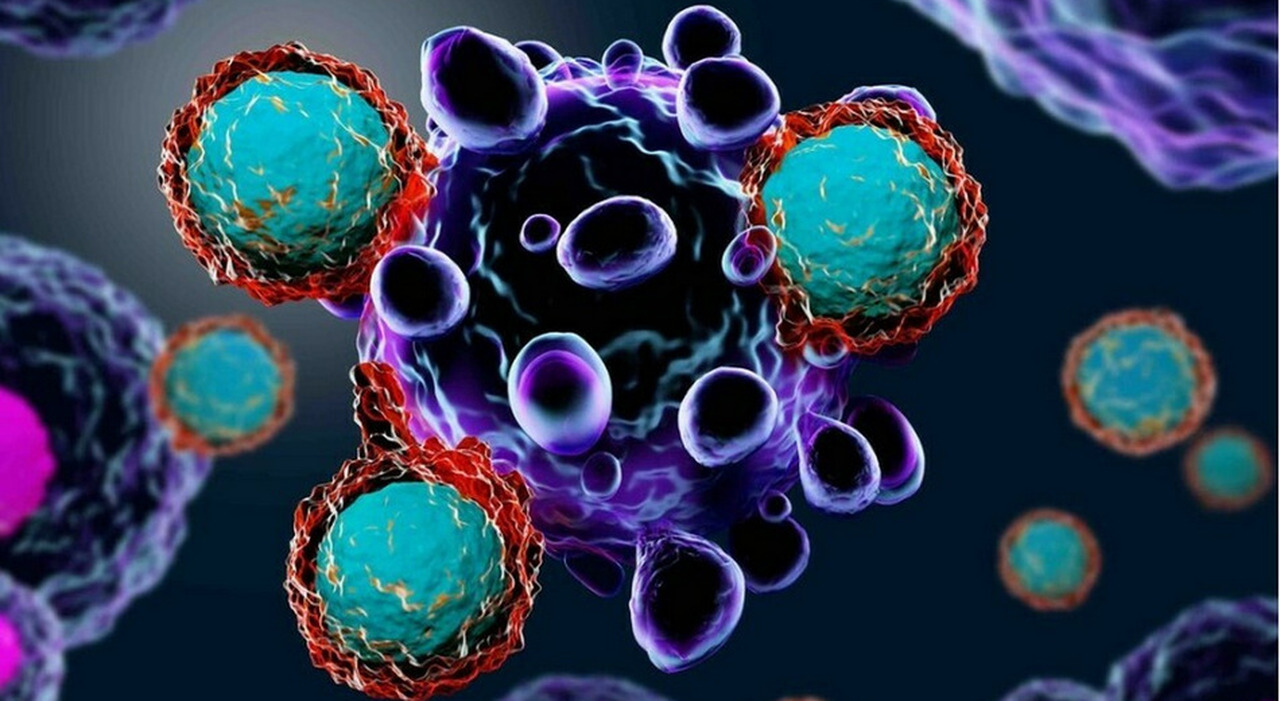

Nelle democrazie tecnologicamente avanzate si sta aprendo un passaggio silenzioso ma decisivo: l’ingresso dell’intelligenza artificiale nelle infrastrutture della difesa non più come semplice strumento operativo, ma come componente della stessa sovranità. L’IA entra nei processi di intelligence, nella pianificazione militare, nella simulazione strategica, nell’analisi dei dati. In definitiva, nella capacità dello Stato di conoscere, prevedere e decidere.

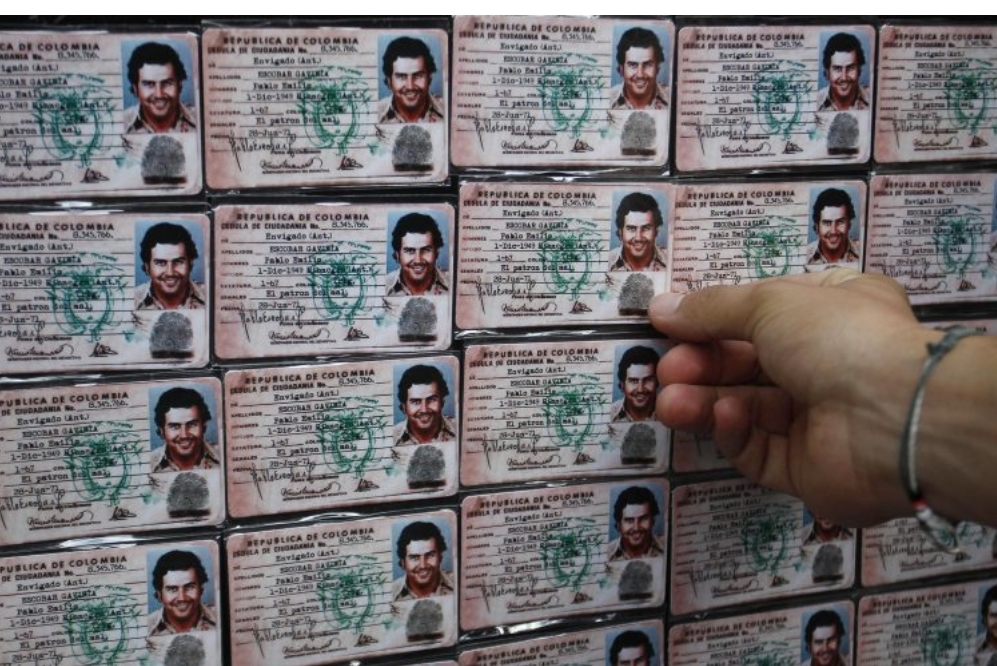

Il confronto emerso negli ultimi giorni negli Stati Uniti tra la società di intelligenza artificiale Anthropic e il Dipartimento della Difesa rende visibile questa trasformazione. L’azienda ha rifiutato l’uso pienamente autonomo di sistemi d’arma e applicazioni di sorveglianza interna di massa, nonostante il Pentagono chiedesse accesso alla tecnologia per “qualsiasi uso legale”. Al di là delle posizioni, colpisce il dato in sé: un fornitore tecnologico che negozia con lo Stato i limiti etici dell’impiego bellico della propria tecnologia.

Il caso non è isolato. Nello stesso periodo, il Dipartimento della Difesa ha avviato l’integrazione del modello Grok, sviluppato da xAI, nelle reti militari classificate e non classificate. Qui non c’è conflitto ma convergenza: piena disponibilità tecnologica e richiesta statale di accesso esteso a dati e capacità algoritmiche. Due traiettorie diverse, ma dentro la stessa dinamica: la difesa nazionale che diventa dipendente da infrastrutture di intelligenza artificiale sviluppate da attori privati, con logiche, interessi e vincoli propri.

Qui si intravede una mutazione profonda. La modernità politica ha collocato la decisione sulla forza dentro la responsabilità pubblica, sottoposta a diritto e controllo democratico. Oggi quella decisione si intreccia con sistemi proprietari di apprendimento e correlazione dei dati. La sovranità non scompare, ma cambia forma: lo Stato resta titolare della decisione, ma la sua capacità di vedere, prevedere e colpire dipende da algoritmi che non possiede né governa interamente.

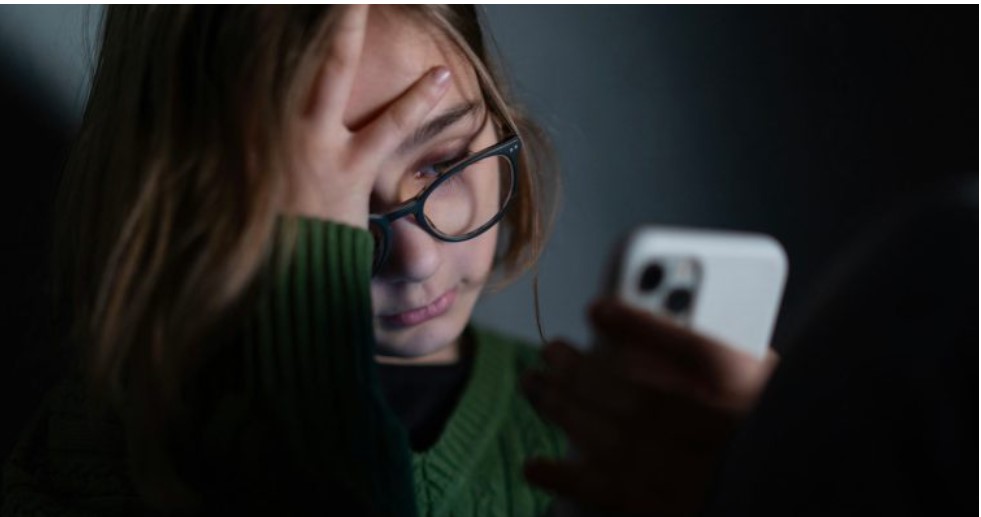

Non è solo un tema industriale o geopolitico. È una questione antropologica. Quando la conoscenza operativa del nemico – e potenzialmente del cittadino – passa attraverso sistemi capaci di integrare su larga scala dati commerciali, digitali e comportamentali, la distinzione tra sicurezza esterna e controllo interno si assottiglia. Non serve un progetto autoritario esplicito: la sorveglianza può emergere come effetto tecnico della correlazione algoritmica delle informazioni disponibili.

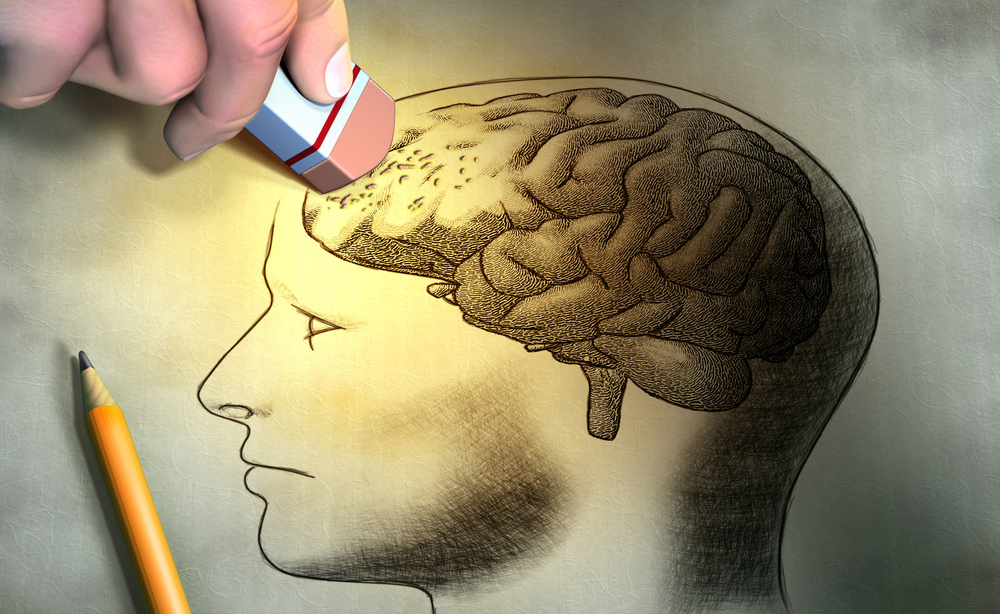

Ancora più radicale è il nodo delle armi autonome. Delegare alla macchina l’individuazione e l’ingaggio del bersaglio sposta la decisione letale fuori dalla coscienza umana immediata. Nella tradizione etica occidentale – e in quella cristiana – l’uso della forza è legato a un soggetto capace di giudizio, intenzione e responsabilità. L’automazione integrale della decisione bellica rompe questo nesso: l’atto resta umano nelle cause remote, ma diventa opaco nell’esecuzione. Non è solo una questione tecnica: è una questione morale.

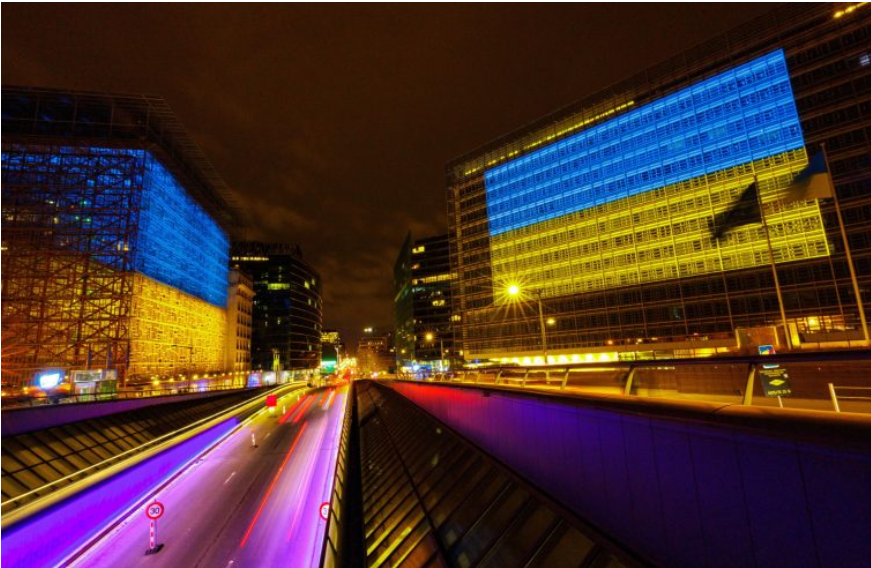

Le democrazie si trovano così davanti a una tensione reale: la necessità di difendersi in un contesto di competizione tecnologica globale e il rischio che gli strumenti adottati per proteggere la libertà ne modifichino silenziosamente la sostanza. La sicurezza algoritmica può rafforzare la difesa, ma anche trasformare il rapporto tra cittadino, Stato e potere tecnologico in modi che nessuna legge vigente riesce ancora a presidiare.

La questione, in definitiva, non riguarda un singolo attore né una scelta contingente. Riguarda la forma che la sovranità assume nell’era dell’IA. Quando la capacità di analizzare, prevedere e decidere dipende da sistemi che operano su scala non umana, non basta più il controllo giuridico dell’uso della forza: occorre interrogarsi su chi progetta, governa e limita gli algoritmi che la rendono possibile. La risposta dirà molto non solo sulla sicurezza delle democrazie, ma sulla loro idea di uomo e di responsabilità.